用例

以下部分介绍了 txtai 的常见用例。还提供了包含 60 多个示例笔记本和应用程序的全面集合。

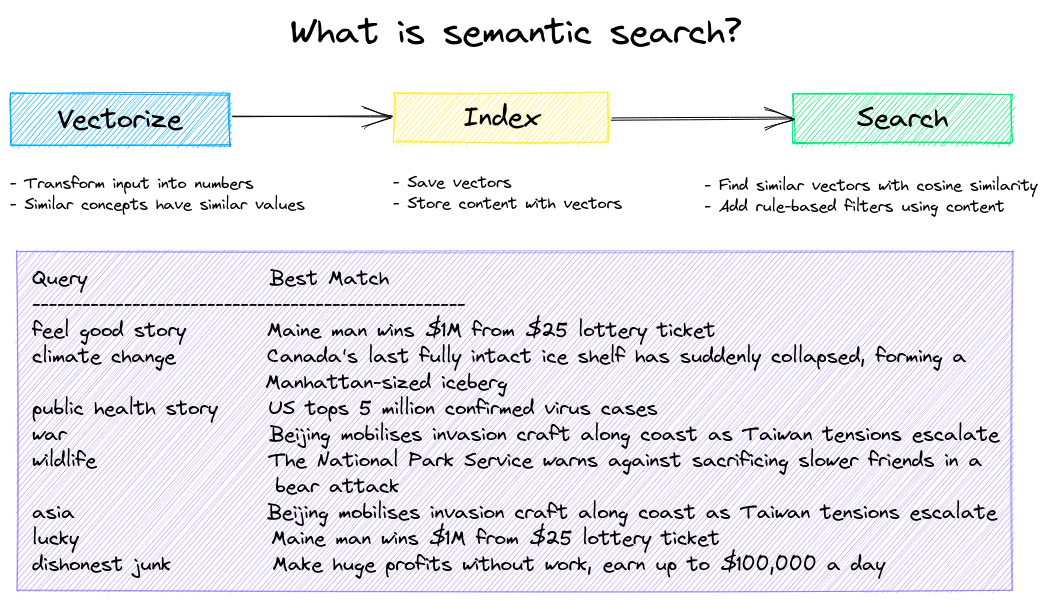

语义搜索

构建语义/相似性/向量/神经搜索应用程序。

传统搜索系统使用关键词查找数据。语义搜索能够理解自然语言,并识别出含义相同(不一定关键词相同)的结果。

从以下示例开始。

| 笔记本 | 描述 | |

|---|---|---|

| txtai 简介 ▶️ | txtai 提供的功能概述 | |

| 带图像的相似性搜索 | 将图像和文本嵌入同一空间进行搜索 | |

| 构建问答数据库 | 使用语义搜索进行问题匹配 | |

| 语义图 | 探索主题、数据连接并运行网络分析 |

LLM 编排

与大型语言模型 (LLM) 交互的自主代理、检索增强生成 (RAG)、与数据聊天、管道和工作流。

参见下方了解更多。

| 笔记本 | 描述 | |

|---|---|---|

| 提示模板和任务链 | 构建模型提示并通过工作流将任务连接起来 | |

| 集成 LLM 框架 | 集成 llama.cpp、LiteLLM 和自定义生成框架 | |

| 使用 LLM 构建知识图 | 使用 LLM 驱动的实体提取构建知识图 |

代理

代理将嵌入、管道、工作流和其他代理连接在一起,以自主解决复杂问题。

txtai 代理基于 smolagents 框架构建。这支持 txtai 支持的所有 LLM(通过 LiteLLM 支持 Hugging Face、llama.cpp、OpenAI / Claude / AWS Bedrock)。

参见下方链接了解更多。

| 笔记本 | 描述 | |

|---|---|---|

| 使用图和代理分析 Hugging Face 帖子 | 使用图分析和代理探索丰富数据集 | |

| 赋予代理自主权 | 代理根据需要迭代解决问题 | |

| 使用图和代理分析 LinkedIn 公司帖子 | 探索如何利用 AI 提高社交媒体参与度 |

检索增强生成

检索增强生成 (RAG) 通过使用知识库作为上下文约束输出来降低 LLM 幻觉的风险。RAG 通常用于“与您的数据聊天”。

txtai 的一个新颖特性是它可以同时提供答案和来源引用。

| 笔记本 | 描述 | |

|---|---|---|

| 使用 txtai 构建 RAG 管道 | 关于检索增强生成的指南,包括如何创建引用 | |

| txtai 的 RAG 工作原理 | 创建 RAG 进程、API 服务和 Docker 实例 | |

| 带图路径遍历的高级 RAG | 图路径遍历以收集复杂数据集用于高级 RAG | |

| 语音到语音 RAG ▶️ | 带 RAG 的全周期语音到语音工作流 |

语言模型工作流

语言模型工作流,也称为语义工作流,将语言模型连接在一起以构建智能应用程序。

虽然 LLM 功能强大,但仍有许多更小、更专业的模型在特定任务上表现更好、速度更快。这包括用于抽取式问答、自动摘要、文本转语音、转录和翻译的模型。

| 笔记本 | 描述 | |

|---|---|---|

| 运行管道工作流 ▶️ | 简单而强大的构造,可高效处理数据 | |

| 生成抽象式文本摘要 | 运行抽象式文本摘要 | |

| 将音频转录为文本 | 将音频文件转换为文本 | |

| 翻译不同语言的文本 | 简化机器翻译和语言检测 |